全球AI算力市场竞赛升级,定制ASIC芯片成新焦点

时间:2025-07-08 01:40

小编:星品数码网

在当今迅猛发展的科技时代,全球人工智能(AI)算力市场正在酝酿着一场前所未有的变革,定制化的应用特定集成电路(ASIC)芯片已逐渐成为行业的焦点。各大科技企业不断在这一领域发力,开启了一场没有硝烟的“车轮战”。OpenAI开始测试谷歌的张量处理器(TPU),而英伟达则推出了新型NVLink Fusion技术,应对由多家业界巨头组成的UALink联盟的挑战。这一切都标志着定制化算力的竞争已步入深水区,ASIC芯片在AI基础设施中愈发显示出其重要性,并有望在2024年实现超越GPU的关键转折点。

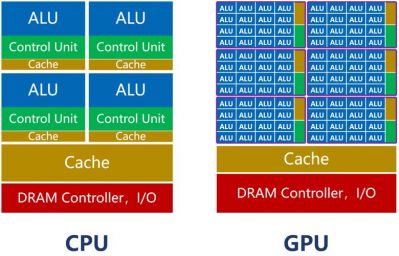

随着高性能计算芯片朝着专用化的方向发展,ASIC芯片凭借其针对特定应用场景优化的设计,逐步在多个领域崭露头角。人工智能是其最为重要的应用方向之一,ASIC芯片通过对深度学习算法的底层优化,展现出了在AI模型训练和推理过程中的高效计算能力和低能耗优势,成为支撑自然语言处理、图像识别等核心技术的关键。近期,OpenAI已选择租用谷歌的TPU芯片,为其ChatGPT等AI产品提供算力支持,这一举动不仅体现了OpenAI对谷歌AI基础设施能力的认可,也为谷歌的云业务增长奠定了良好的基础。

TPU作为ASIC芯片典型架构的代表,其在深度学习中的优势开始逐渐显现。OpenAI的这一选择,将可能削弱英伟达在GPU市场的主导地位。对此,行业分析师指出,随着多样化需求的不断延伸,ASIC芯片相较于通用芯片和FPGA芯片在高性能、低功耗及更具竞争力的成本上正逐步占据优势。

英伟达对此的紧急反应也进一步表明了ASIC市场的火爆。该公司在5月发布的NVLink Fusion技术,旨在将其高速互连技术与来自第三方如ASIC、CPU等异构芯片深度融合。行业内的诸多半导体公司如联发科、Marvell和Cadence已成为首批采用此技术的企业。英伟达CEO黄仁勋强调,NVLink Fusion将进一步开放NVIDIA AI及其丰富的生态系统,以助力合作伙伴构建专门的AI基础设施。

UALink联盟作为AI服务器芯片互连的组织,旨在建立一个开放的生态系统,成员包括亚马逊AWS、阿里巴巴、AMD、苹果、谷歌等顶尖科技公司。面对日益增长的AI算力需求,越来越多的云服务科技巨头开始将自研ASIC作为重点布局方向。谷歌不仅已经完成更新七代TPU,Meta也计划于今年第四季度推出首款AI ASIC芯片MTIA T-V1,AWS则推进不同版本的Trainium v3开发,预计于2026年全面投产。

虽然自研ASIC的路途充满挑战,微软在自研AI芯片方面遇到的障碍也显示出这一过程的复杂性和风险,原定于今年投产的Braga芯片可能将推迟至2026年。ASIC市场的前进势头依然不减。博通和Marvell的最新财报显示,博通预计到2025年二季度其AI相关业务收入将达44亿美元,同比增长46%。Marvell也报告称,其数据中心业务已成为核心引擎。

在ASIC芯片及云巨头的共同努力下,AI算力市场正在迎来新的临界点。目前,英伟达GPU占据AI服务器市场超过80%的份额,而ASIC仅占8%-11%。预测显示到2025年,谷歌和亚马逊AWS两家合计的ASIC芯片出货量有望与英伟达持平,届时ASIC市场格局或将发生根本性变化。

尽管ASIC芯片在设计、制造和生产方面面临较高的复杂性和成本,但其在性能和能效上的优势让其成为未来AI算力的重要骨干。全球市场上,ASIC的竞争格局呈现出“北美主导、中国加速、新兴市场爆发”的态势。国际巨头通过技术壁垒垄断市场,同时新兴企业和初创公司也逐步介入。尽管国内企业在许多方面尚需追赶,但借鉴北美企业的经验,提升自身技术及产品竞争力,将有助于提高在全球ASIC芯片市场中的地位。

在不断变革的AI算力领域,定制化与高效能的ASIC芯片将迎来更广阔的市场,由此,全球AI算力的行业格局必将经历一场深刻的重塑。