中国学者研发R1-Code-Interpreter,提升大模型符号计算与推理能力

时间:2025-07-05 04:10

小编:星品数码网

近日,中国科学技术大学的校友陈勇超博士及其团队在人工智能领域取得了一项重要突破,研发出名为R1-Code-Interpreter的系统,这一系统旨在提升大型语言模型(LLMs)在执行符号计算与推理任务时的能力。该研究首次将多步监督微调(SFT)与群体相对策略优化(GRPO)结合,训练模型在144个推理和规划任务上自如地运用代码执行器。这一创新的研究不仅推动了大模型在复杂任务中的表现,也在人工智能与人类思维方式的融合上迈出了重要一步。

陈勇超及其团队最初以Qwen-3B/7B/14B为基础模型进行训练,模型通过多轮的代码执行器调用来辅助其推理。这一训练过程涉及到符号计算的多样性,而模型则需要自行学习在何时应使用文字推理,何时应调用符号计算。团队发现,大多数模型在经过大量文字推理训练后,其代码生成能力有时反而会下降,这一现象在Leetcode等代码基准测试中并不明显,因为问题的解析阶段容易被忽略。实际上,许多实际问题都涉及到对抽象问题的思考与解析,因而这些能力的下降影响了模型的整体表现。

除了能力下降,任务多样性也给模型的训练带来了挑战。虽然训练单一任务的代码执行器相对简单,但随着任务类型的增加,模型在选择适当的策略时越来越困难,甚至有时针对某些任务的策略偏好会相互抵触。基于此,陈勇超认为,仅依靠强化学习难以取得理想效果,强调了SFT阶段在研究中的核心作用。

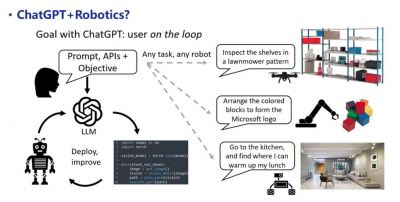

在未来,陈勇超预测,基于大模型的智能代理或具身智能系统将在许多复杂任务中融入符号计算。许多机器人领域的学者认为,未来的模式应从“视觉-语言-动作”转变为“视觉-语言-控制”,这将大大拓展人工智能的应用场景,包括旅行规划、网页任务及各类科学问题的解决。同时,尽管某些任务可能不直接需要符号计算,但仍可能需要代码执行,例如在任务中实现数据可视化等方面。因此,模型的训练与代码执行器的整合显得尤为迫切。

R1-Code-Interpreter的开发是研究团队在“基于符号计算的大模型推理规划”这一大课题的一部分。目前大多数大模型推理规划主要依赖纯神经网络及文字推理,而许多任务实际上需要结合符号来优化与规划,例如,用户出行的机票、酒店及时间安排的选择,就是在多种因素下进行的复杂优化问题。针对这一点,团队之前的工作如AutoTAMP与TravelPlanner等,已在机器人和旅行任务中将符号计算工具与大模型结合,取得了良好效果,但在泛化性方面仍然存在局限。

在大模型的强大泛化性与符号计算的结合方面,研究团队提出了将代码作为载体,以实现多种算法、控制器和规划器的融合。由于符号计算往往依赖于预设规则的算法调用,结合大模型的代码能力,可以实现更加灵活高效的推理与规划。

为了提高代码执行器的应用能力,研究团队探索了两条路径:一是训练一个辅助模型以指导主模型,通过主模型发挥最大潜力;二是直接微调模型,以兼顾文本推理和符号计算的能力。经过实验发现,辅助模型CodeSteer表现良好,能够帮助主模型充分利用符号计算来处理很多推理规划任务。而在当前的R1-Code-Interpreter工作中,团队进一步探讨了第二种微调策略的可行性。

相关研究论文《R1-Code-Interpreter:通过监督学习与强化学习训练大语言模型的代码推理能力》已经发布到arXiv,标志着研究团队在大模型符号计算与推理领域的重要成果。陈勇超认为,未来的大模型在进行推理和规划任务时,应该能在自己生成答案、调用外部工具和生成代码三种方法之间灵活切换与衔接,这将极大提高模型在多样化任务中的效率。

展望未来,陈勇超及其团队计划进一步探讨如何将这三种模式结合使用,并希望能在实践应用中验证其构想的可行性。这一系列的研究不仅推动了人工智能的发展,也将启发更多学者在符号计算与语言推理的结合上进行深入探索,为未来的人工智能应用开辟新的方向。